Addy Osmani, développeur chez Google, a récemment partagé une checklist sur l’optimisation pour les agents IA.

Addy ne parle pas exactement de visibilité sur les LLMs. Il évoque plutôt une logique d’optimisation pour les agents IA, ou ce qu’il appelle l’Agentic Engine Optimization (AEO).

Le concept reste proche de l’optimisation pour les LLMs, mais avec un léger décalage : on ne vise plus seulement à être visible, mais à être utilisable, actionnable par des agents, un peu a la manière du WebMCP.

Je devais donc en parler.

Et au passage, on ajoute un acronyme de plus à la collection : SEO, GEO, CRO… et maintenant AEO. Cool !

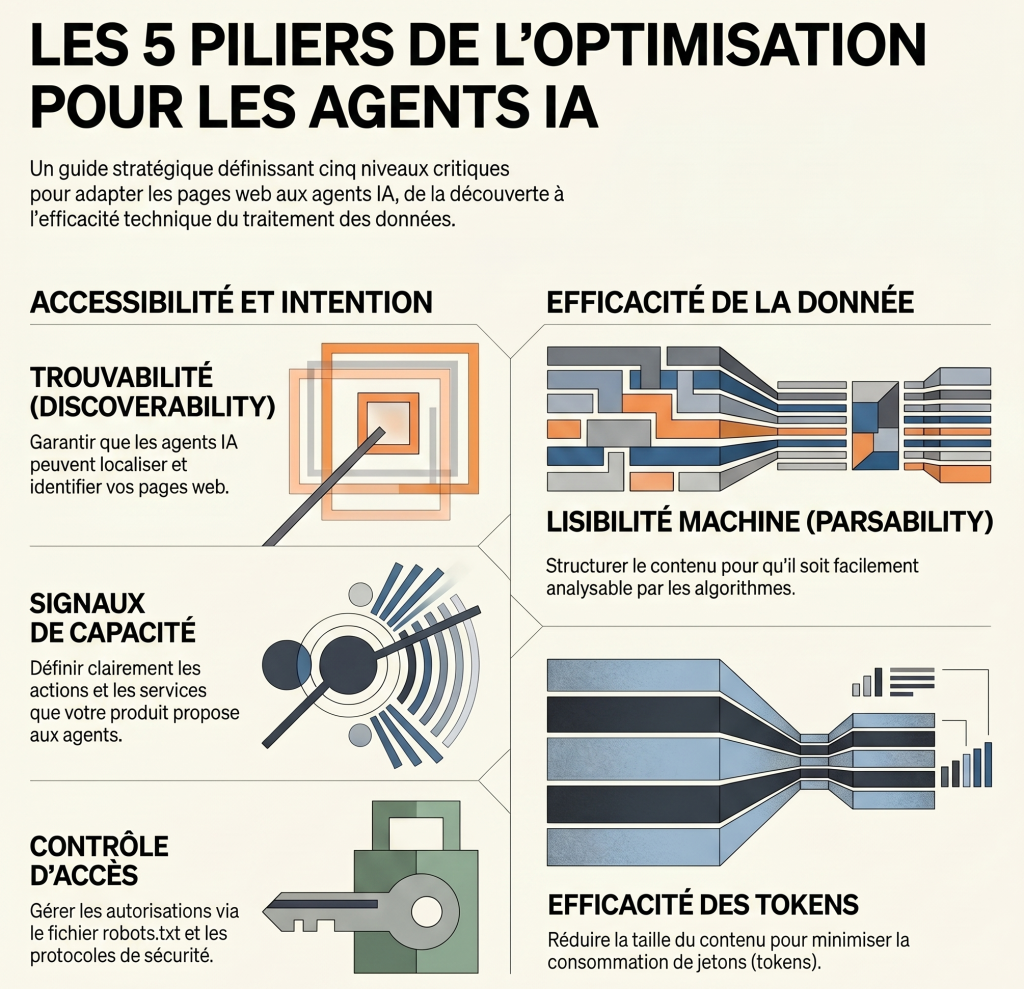

Les 5 niveaux d’optimisations pour les agents IA

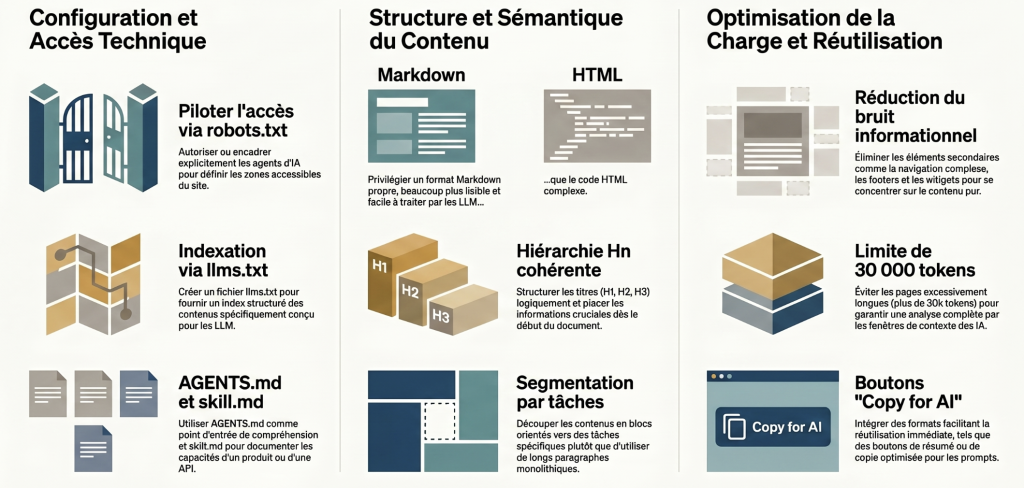

Addy abode ces 5 niveaux pour optimiser vos pages pour les agents IA et les rendre utilisable :

- Discoverability (trouvabilité)

- Parsability (lisibilité machine)

- Token efficiency (taille)

- Capability signaling (ce que fait ton produit)

- Access control (robots.txt & co)

Comment optimiser pour les Agents IA ?

Trouvabilité- robots.txt (Discoverability)

- Check : Les IA sont autorisées sur votre site ? Le Crawl est il bloqué ?

- Solution : Autorisez explicitement les crawlers IA à accéder à votre site.

Trouvabilité -llms.txt (Discoverability)

- Check : Vous avez un LLM.txt ?

- Solution : Créez un fichier llms.txt qui liste et décrit vos contenus clés. Ça sert de sitemap pour IA qui leur évite de crawler votre site à l’aveugle.

Signal de capacité – skill.md (Capability signaling)

- Check : Vous avez un skill.md qui décrit ce que vos APIs font ?

- Solution : Décrivez ce que votre produit ou API permet de faire concrètement. Les agents comprennent ainsi directement si ton outil répond à l’intention utilisateur.

Accessibilité – Agents.md (Access)

- Check : vos pages sont facilement accessibles ? Les IA ont des points d’entrés ?

- Solution : Ajoutez un fichier AGENTS.md à la racine de votre projet. Il sert de point d’entrée aux agents pour comprendre ton environnement et tes ressources.

Mise en forme du contenu (Content formatting)

- Check : Vos contenus sont facilement extractibles ?

- Solution : Proposez une version Markdown propre de vos pages. Les LLM lisent mieux du texte brut structuré que du HTML rempli de bruit.

PS : Google a commencé a mettre en place des pages Markdown sur leurs pages. En revanche Jhon Mueller a explique que, comme c’était le cas du LLM.txt mis l’année passée, ce n’est pas forcement une confirmation que le format est efficace.

Ce que font les équipes de Google n’est pas un endorsement.

Structure des pages

- Utilisez une structure H1 → H2 → H3 cohérente et logique. Les agents scannent la structure plutôt que lire linéairement.

- Placez les infos essentielles dès le début de la page. Les agents utilisent surtout les premiers tokens pour décider de la pertinence.

- Évitez les éléments inutiles (menus, footers, breadcrumbs) dans le contenu parsable. Ces éléments polluent le contexte et réduisent l’efficacité des agents.

- Découpez votre contenu par tâche ou endpoint plutôt que par page massive. Les agents préfèrent plusieurs petits blocs pertinents qu’un seul document lourd.

- Organisez vos contenus par objectif utilisateur, pas par structure interne. Les agents cherchent à résoudre un problème, pas à explorer ton site.

- Utilisez des tableaux pour les paramètres et collez le code près des explications. Cela améliore la compréhension rapide et réduit le coût en tokens.

Token surfacing

- Limitez la taille des pages et segmentez le contenu.Un contenu trop long risque d’être ignoré, tronqué ou mal interprété.

J’ai deja dit que l’optimisation pour les tokens est la nouvelle optimisation des budgets crawl. Eh, je n’avais pas tort.

UX bridge (Copy for AI)

Perso, je mets a disposition le bouton resumer avec IA sur les articles pour les lecteurs. Après, je ne le fais pas que pour la praticité. Y a aussi un enjeu de manipulation de la memoire des IA.

Addy Osmanie propose de faire la même chose(en quelque sorte) pour les IA avec le bouton Copier pour IA. Qui facilite le copier coller depuis vos pages.

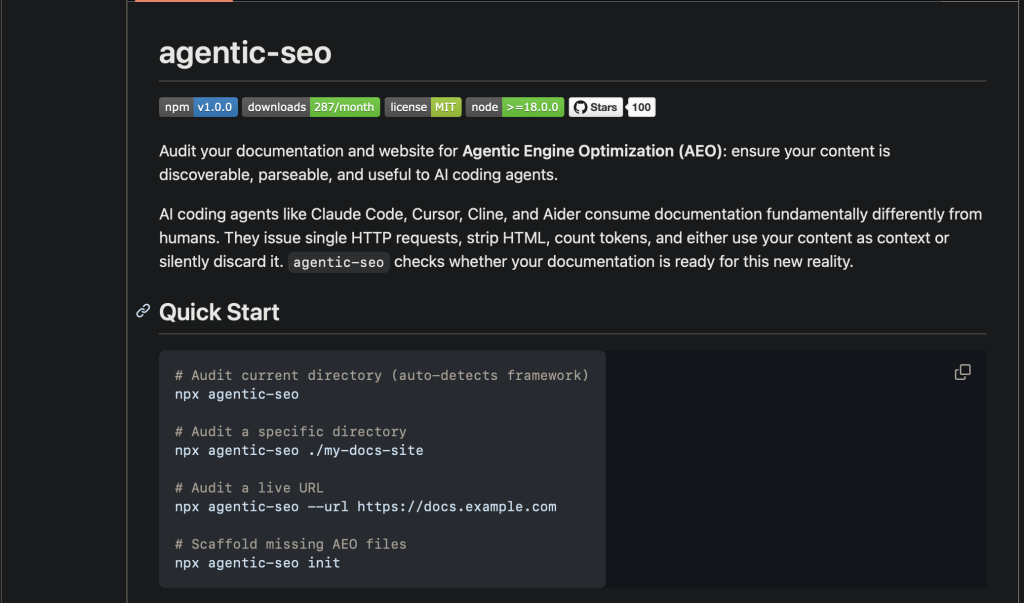

Comment faire un audit de visibilité sur les agents ia ?

Addy Osmani a proposé un outil Github pour faire un audit / avoir des recommendations pour l’optimisation de vos pages pour les agents IA.

PS : je n’ai pas encore essayé… TBD.

Checklist Google GEO et agents IA

Si vous devez priorisez les choses, voici ce qu’il faut faire selon Addy Osmani :

- Le fichier llms.txt est présent à la racine et contient un index structuré de toute la documentation ?

- Le fichier robots.txt ne bloque pas par inadvertance les user-agents connus des agents IA ?

- Le fichier agent-permissions.json définit les règles d’accès pour les clients automatisés ?

- Le fichier AGENTS.md est présent dans les dépôts de code et renvoie vers les documents pertinents ?

- Les pages de documentation sont disponibles au format Markdown brut (et non uniquement en HTML rendu) ?

- Chaque page commence par un énoncé clair des résultats dans les 200 premiers mots ?

- Les titres sont cohérents et hiérarchiquement corrects ?

- Les exemples de code suivent immédiatement leur description en texte ?

- Les références aux paramètres utilisent des tableaux, et non du texte imbriqué ?

- Le nombre de tokens est suivi pour chaque page de documentation ?

- Aucune page ne dépasse 30 000 tokens sans stratégie de fractionnement ?

- Le nombre de tokens est indiqué dans llms.txt pour les pages clés ?

- Le nombre de tokens est disponible sous forme de métadonnées de page (balise meta ou en-tête HTTP) ?

- Les fichiers skill.md décrivent ce que fait chaque service/API, et pas seulement comment l’appeler ?

- Chaque compétence comprend : les capacités, les entrées requises, les contraintes, les liens vers les documents clés ?

- Serveur MCP disponible pour l’intégration directe d’agents (le cas échéant) ?

- Sources de référence IA segmentées dans les analyses Web ?

- Les logs sont mis en place pour détecter les empreintes HTTP connues des agents IA ?

- Référence établie pour le rapport entre le trafic IA et le trafic humain ?

- Bouton « Copier pour l’IA » disponible sur les pages de documentation ?

- Code source Markdown accessible via une convention d’URL (par exemple, en ajoutant l’extension .md) ?

Mon avis sur la checklist pour l’optimisation pour les agents IA

Bon, soyons honnêtes : ce n’est pas une checklist officielle de Google. Rien n’indique que la team Search ait validé tout ça. On est sur la vision de Addy Osmani, pas sur une recommandation produit.

Si vous cherchez une checklist plus complète et orientée visibilité sur les LLMs, j’ai préparé un article dédié avec les outils GEO que j’utilise personnellement.

PS : mes outils sont un peu atypiques. Si vous cherchez plutôt les outils GEO “grand marché”, j’ai aussi une sélection des plus utilisés.

PPS : ce ne sont pas forcément les plus connus, mais ils sont intéressants à regarder.

Laisser un commentaire

Vous devez vous connecter pour publier un commentaire.