Dans cet article

WebMCP, c’est quoi ?

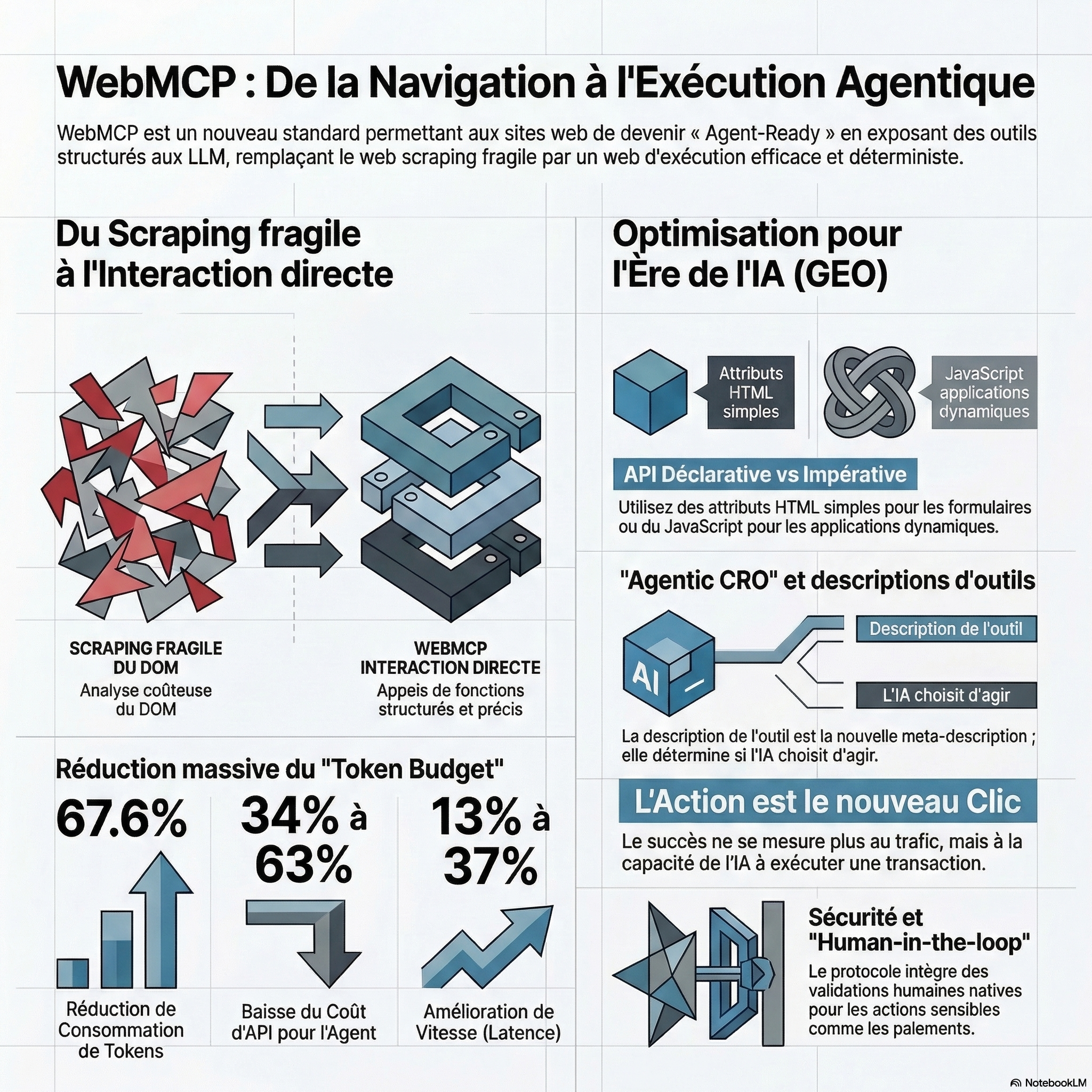

WebMCP est un protocole standardisé (proposé par des ingénieurs de Google et Microsoft au W3C) qui permet à un site web d’exposer des outils structurés directement au navigateur. Au lieu de scraper, l’IA appelle une fonction précise (ex: book_flight) avec des paramètres typés.

Pourquoi le WebMCP est important ?

Le WebMCP émerge comme une solution pour aider les LLMs avec capacités argentiques a comprendre parfaitement le contenu de votre site et leurs donner la capacité a faire des actions précises ex remplir des formulaires.

Si vous me demandez mon avis, le WebMCP est le successeur des données structurées.

Certains SEO disent que le web est en train de vivre sa plus grande transformation depuis l’introduction de JavaScript et des données structurées.

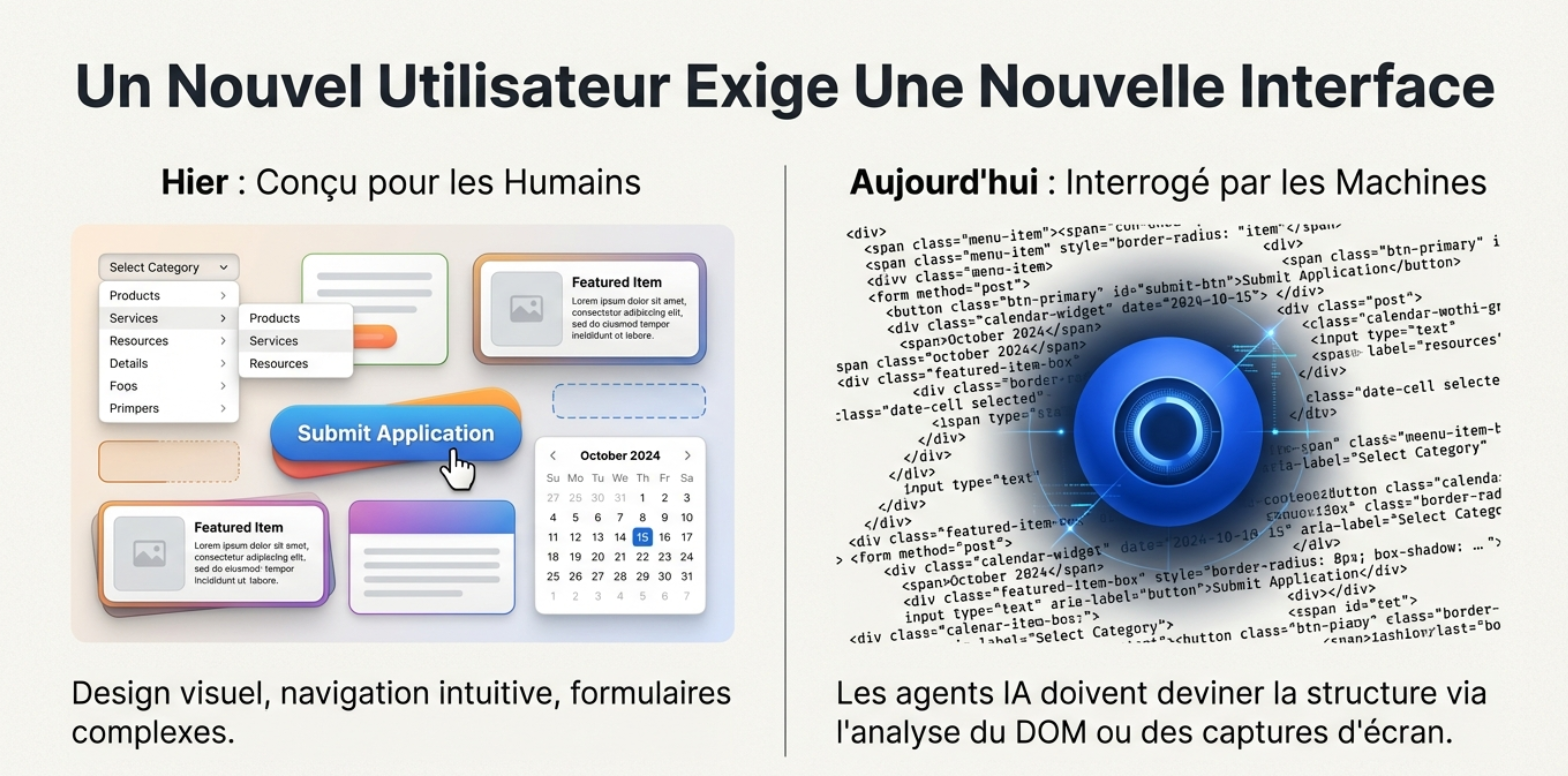

Les limites du Web Scraping et du DOM

Aujourd’hui, pour qu’un agent IA (comme ChatGPT, Claude ou Gemini) interagisse avec un site web, il doit agir comme un humain. Il utilise deux approches imparfaites :

- L’analyse visuelle (Screenshots) : L’agent prend une capture d’écran et utilise un modèle de vision pour deviner où cliquer. Cette méthode est lente, coûteuse en tokens et très fragile.

- L’analyse du DOM : L’agent lit le code HTML brut de la page. Avec les applications modernes (React, Angular), le DOM est rempli de balises

<div>complexes et de classes CSS illisibles qui ne décrivent pas les actions possibles, ce qui oblige l’IA à faire du « reverse-engineering ».

En conséquence, un processus simple peut consommer entre 10 000 et 100 000 tokens et échouer à la moindre modification de l’interface.

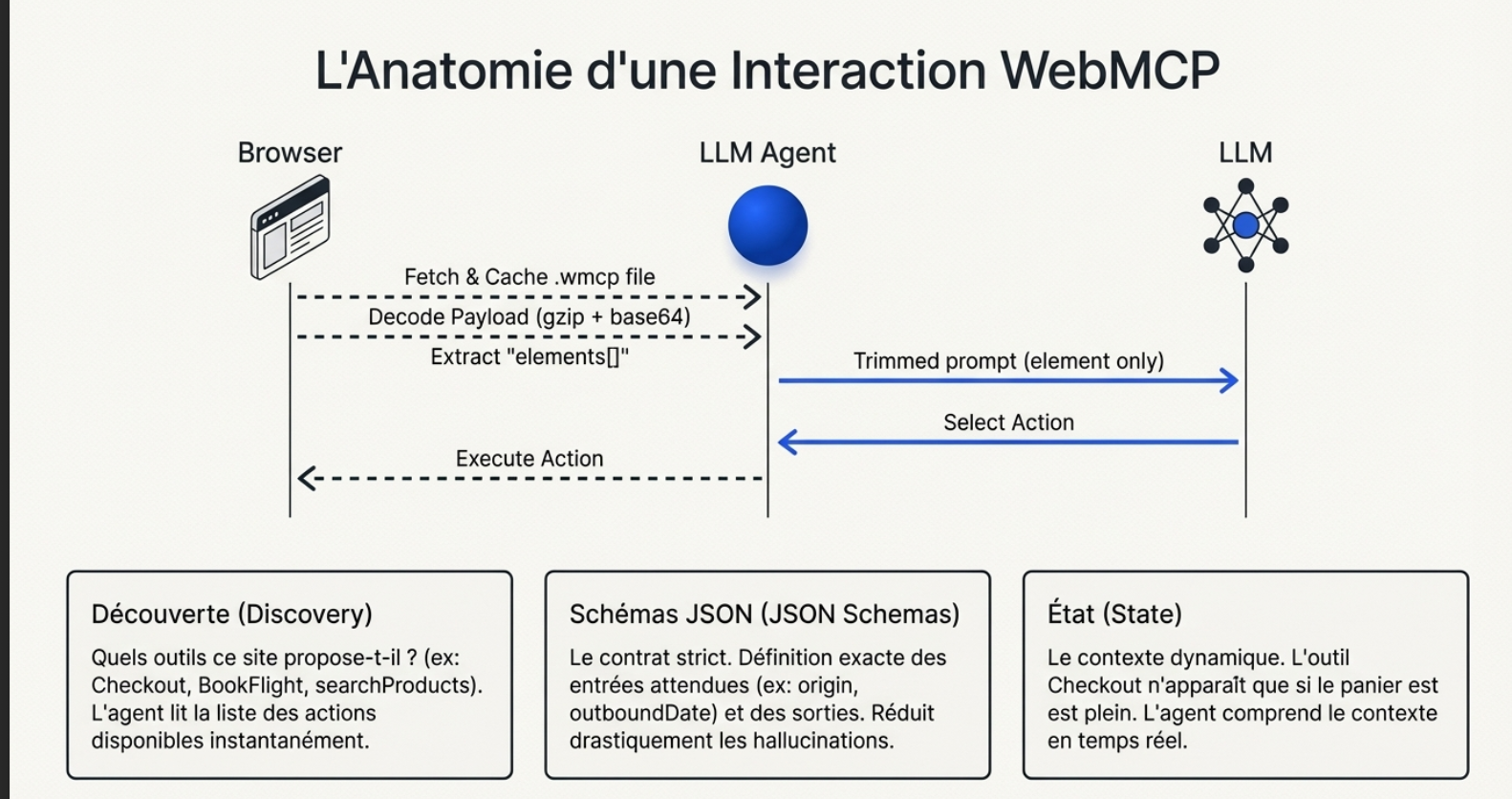

Comment le WebMCP optimise ton site pour les LLM ?

Le protocol Webmcp rends les sites « Agent-Ready ».

Concrètement, WebMCP élimine le besoin des LLMs d’analyser le Dom et les captures d’écran d’un site pour comprendre le contenu d’un site. Le site web déclare explicitement à l’agent : « Voici ce que je peux faire, voici les paramètres dont j’ai besoin, et voici comment m’utiliser ».

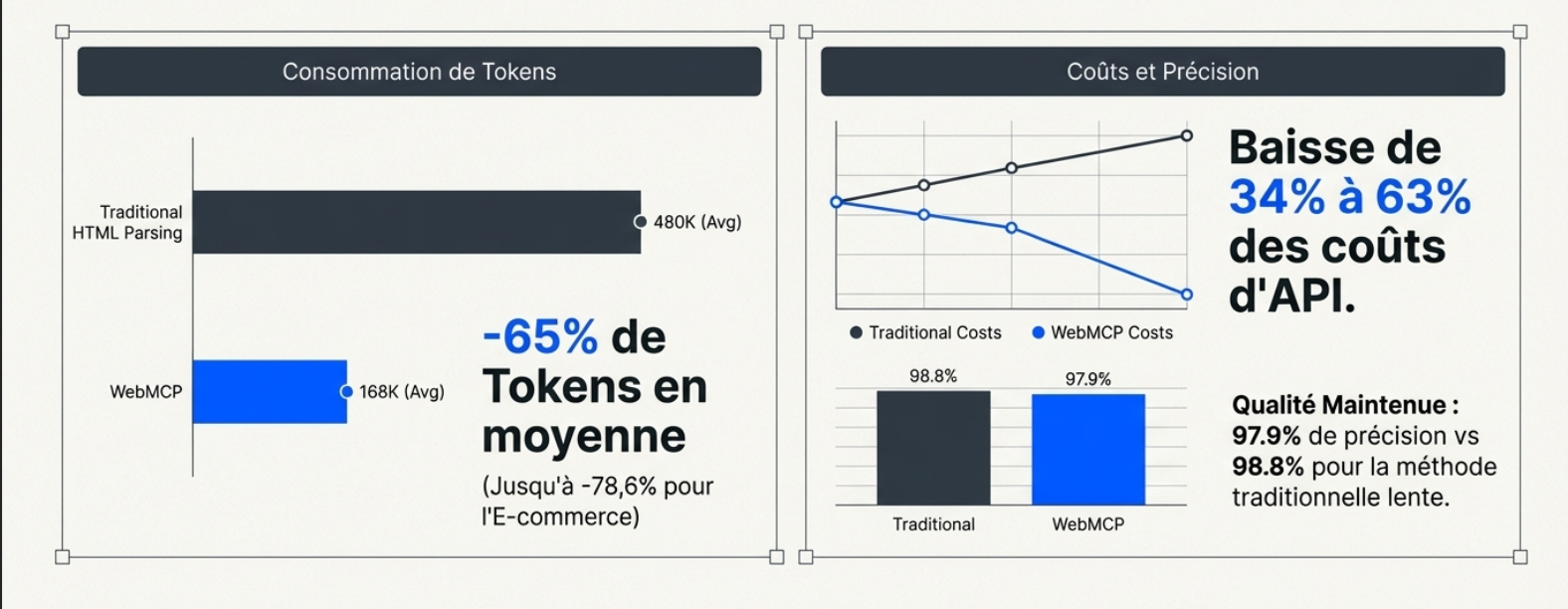

En fournissant un graphe d’interaction structuré, WebMCP permet de réduire l’utilisation des tokens d’environ 65 % en moyenne (jusqu’à 78,6 % pour l’e-commerce) et de faire baisser les coûts des API LLM de 34 à 63 %.

Comment fonctionne le WebMCP ?

WebMCP peut être utilisé de deux manières !

WebMCP avec l’API déclarative (solution plus simple)

Idéale pour les formulaires statiques et le e-commerce de base. Elle utilise des attributs HTML spécifiques.

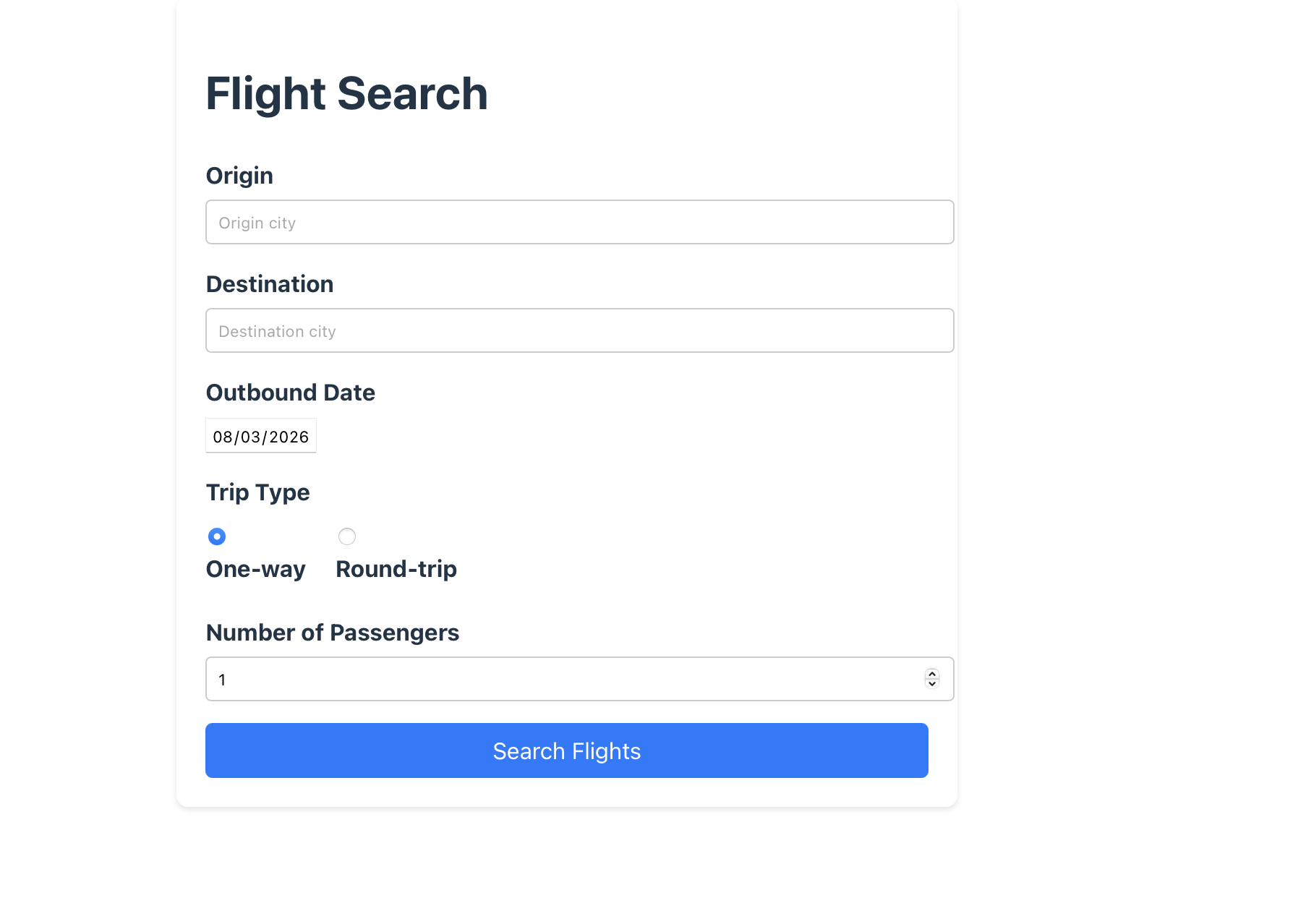

Pour les sites disposant déjà de formulaires HTML, l’API déclarative transforme ces derniers en outils compréhensibles par l’IA avec un minimum d’effort. Il suffit d’ajouter des attributs spécifiques à la balise <form> :

toolname: Le nom de l’outil (ex: « searchFlights »).tooldescription: La description en langage naturel de ce que fait l’outil.toolautosubmit: (Optionnel) Indique si le formulaire doit être soumis automatiquement par l’agent ou s’il nécessite une validation humaine.

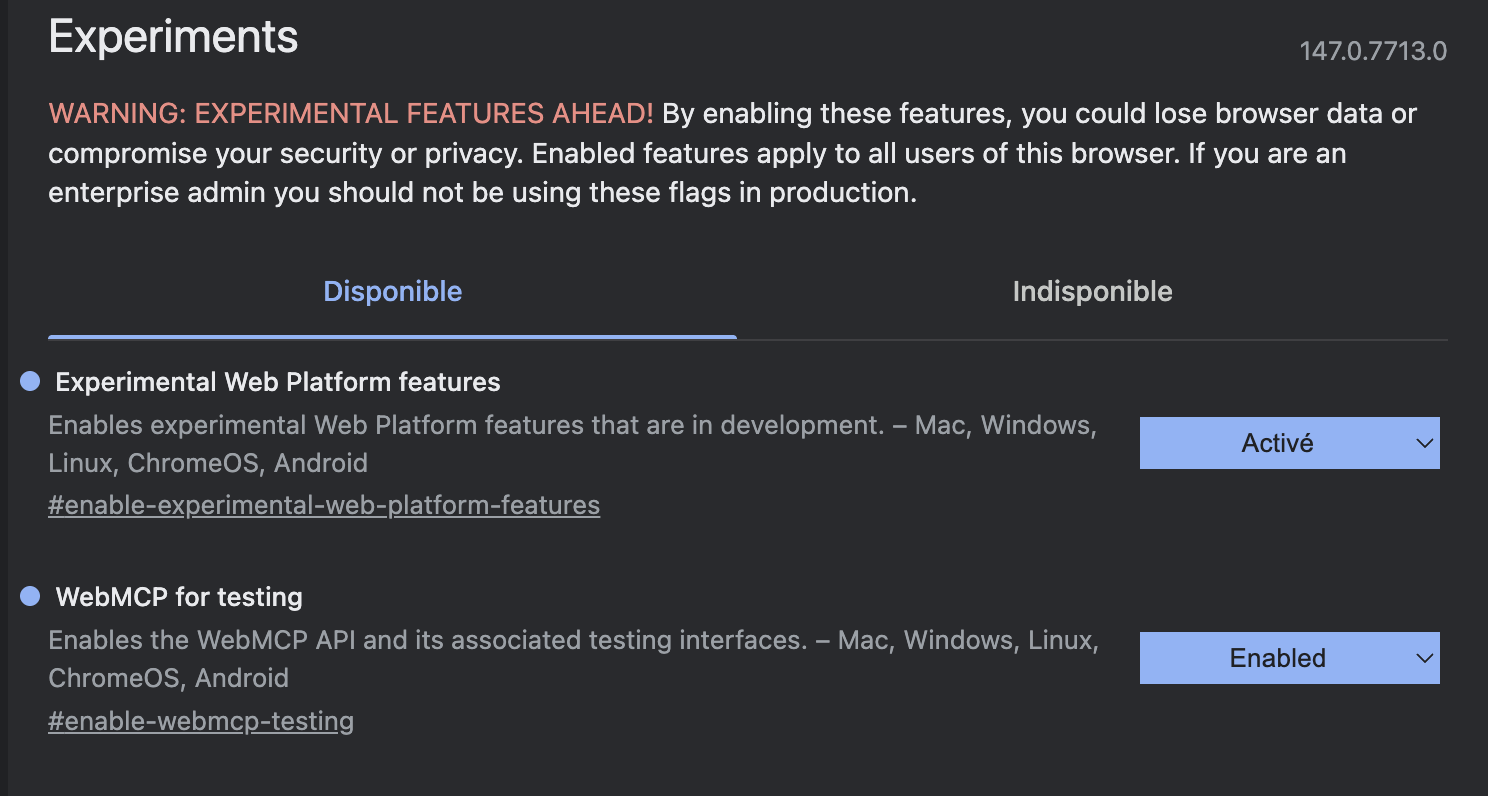

Étape 1 : Activer le support navigateur Pour tester localement, utilisez Chrome Canary (version 146+) et activez le flag : chrome://flags/#enable-webmcp-testing.

Étape 2 : Annoter les balises <form> Ajoutez les attributs toolname et tooldescription à l’élément form, et toolparamdescriptionaux inputs.

Le navigateur traduit automatiquement les champs du formulaire en un schéma JSON que l’agent IA peut lire et remplir.

<form toolname="book_flight" tooldescription="Réserver un vol commercial">

<input name="origin" toolparamdescription="Code aéroport de départ au format IATA (ex: CDG)">

<input name="destination" toolparamdescription="Code aéroport d'arrivée au format IATA">

<input name="date" type="date">

<button type="submit">Rechercher</button>

</form>WebMCP avec l’API Impérative (solution plus complete)

Pour les applications web dynamiques (SPA) dont l’état change constamment, l’API impérative utilise le JavaScript via navigator.modelContext.registerTool().

Vous définissez un nom, une description, un schéma d’entrée JSON et une fonction execute(le gestionnaire de l’action). L’avantage majeur est que les outils peuvent être enregistrés ou supprimés dynamiquement en fonction de l’état de la page (par exemple, un outil de paiement n’apparaît que si le panier n’est pas vide).

Étape 1 : Définir le schéma JSON L’agent d’IA a besoin d’un contrat strict.

Étape 2 : Enregistrer l’outil via navigator.modelContext L’outil est enregistré dans l’objet global du navigateur, exposant son nom, sa description et sa fonction d’exécution (execute).

if ('modelContext' in navigator) {

navigator.modelContext.registerTool({

name: "add_item_to_cart",

description: "Ajoute un produit spécifique au panier de l'utilisateur via son ID",

inputSchema: {

type: "object",

properties: {

productId: { type: "string", description: "L'identifiant unique du produit" },

quantity: { type: "number", minimum: 1 }

},

required: ["productId", "quantity"]

},

async execute({ productId, quantity }) {

const response = await fetch('/api/cart/add', {

method: 'POST',

body: JSON.stringify({ productId, quantity })

});

return response.json(); // Retour structuré pour l'agent

}

});

}Comment tester WebMCP aujourd’hui ?

Le standard est en version préliminaire, mais vous pouvez commencer à l’expérimenter :

- Téléchargez Chrome Canary.

2. Activez le flag chrome://flags/#enable-webmcp-testing.

3. Utilisez des bibliothèques open-source comme MCP-B (@mcp-b/global), qui agit comme un polyfill pour intégrer l’API W3C à n’importe quel navigateur et fait le pont avec les clients IA existants.

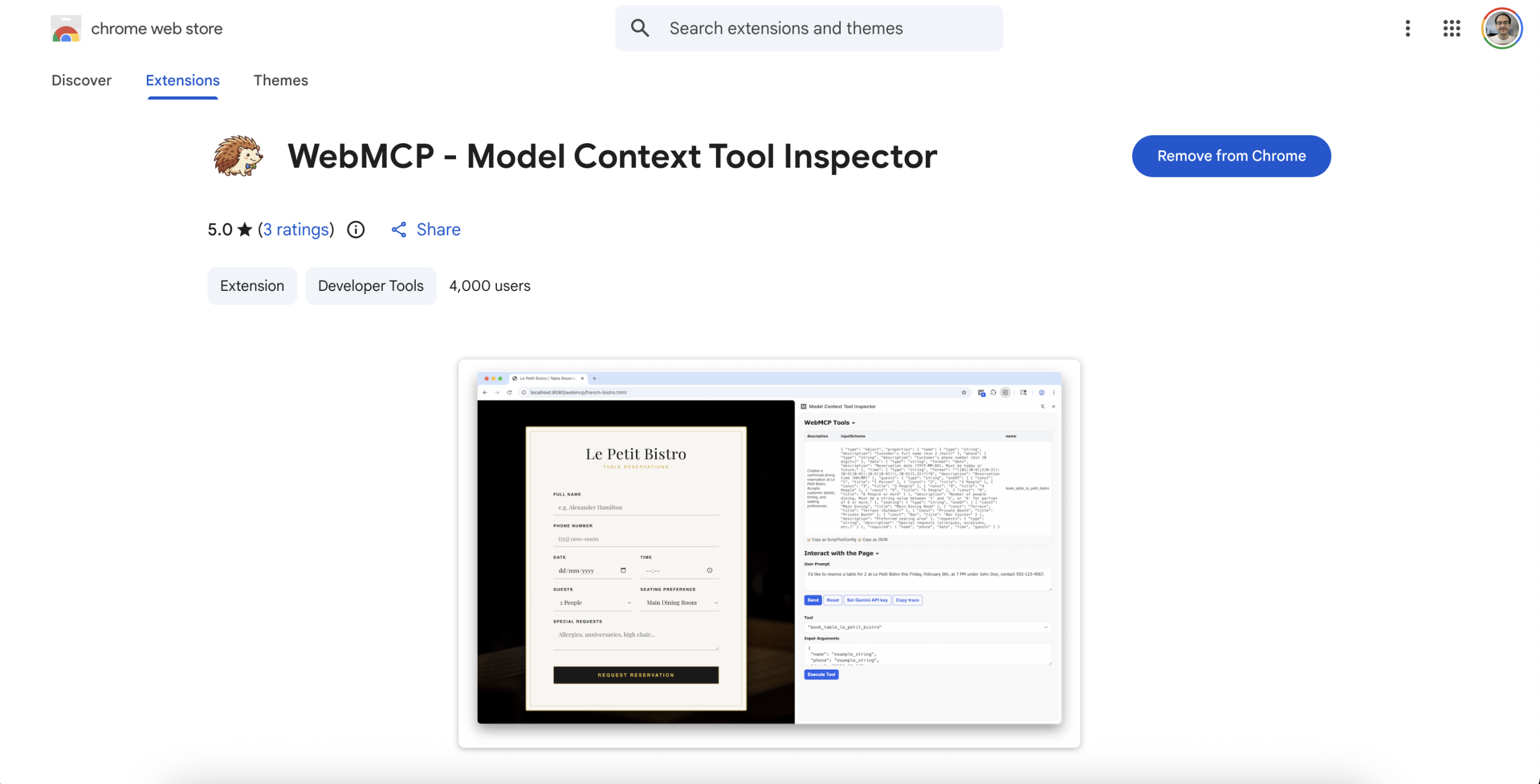

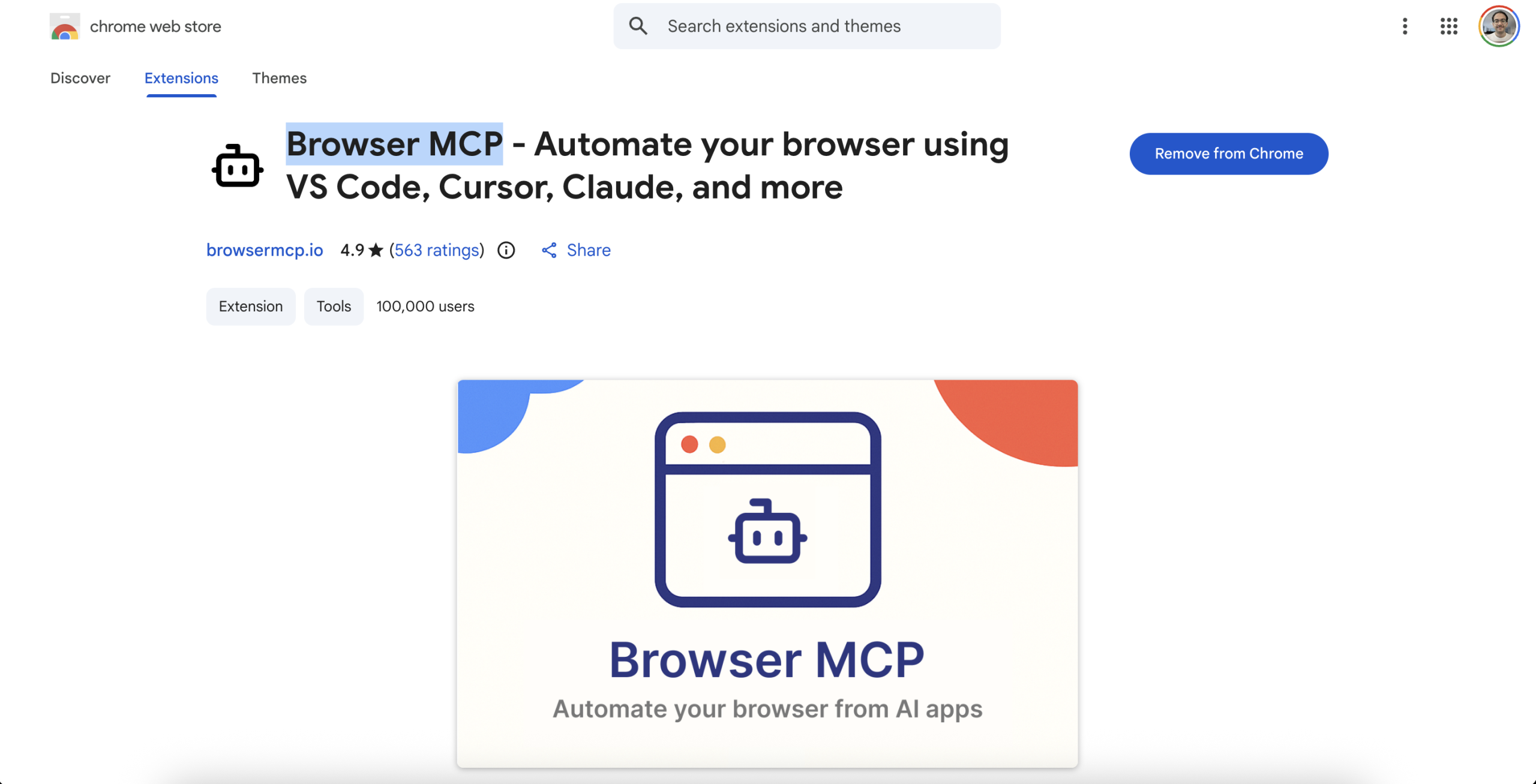

4. Installez une extension Model Context Tool comme. Vous avez l’embarras du choix.

Pour que l’agent d’extension fonctionne, vous avez besoin d’une clé API Gemini. Celle-ci peut être obtenue gratuitement à des fins de test.

Pour cela, il suffit de créer un nouveau projet dans Google AI Studio, puis de cliquer sur « Créer une clé API ».

Cette clé API sera ensuite utilisée dans l’extension.

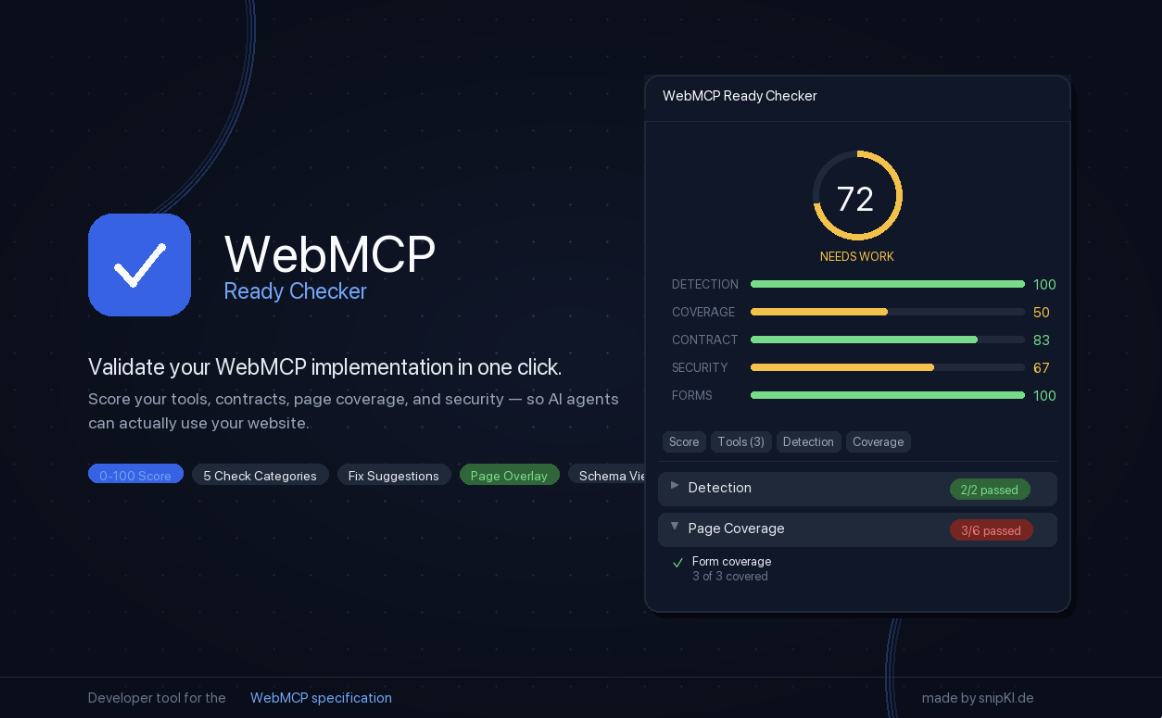

Il est également possible de la tester via ce site web mis à disposition à cet effet. Si tout fonctionne correctement, nous devrions voir que l’outil est détecté et qu’il peut être invoqué directement depuis l’extension.

Impact du WebMCP sur le GEO et SEO

Les recherches menées, notamment sur des stacks WordPress et e-commerce, indiquent que l’adoption du standard WebMCP améliore l’efficacité des interactions avec les LLM : réduction de la consommation de tokens, diminution des coûts d’API et accélération du temps de récupération des réponses.

| KPI | Impact WebMCP |

| Consommation de Tokens | Réduction de 67.6% en moyenne. |

| Coût d’API pour l’Agent | Baisse de 34% à 63%. |

| Qualité des réponses | Maintenue à 97.9% (contre 98.8% en manuel). |

| Vitesse (Latence) | Amélioration de 13% à 37% sur les flux complexes. |

Quelles sont les optimisations / KPI du WebMCP ?

Le GEO de demain ne se limite plus à être cité par un LLM ; il agira sur la capacité d’un site d’être utilisable par un agent generative.

Si un utilisateur demande à son IA de « réserver le vol le moins cher pour Paris », les sites optimisé pour le SEO / GEO dotés d’outils WebMCP fiables capteront ce trafic, tandis que les autres n’existeront tout simplement pas dans l’espace de décision de l’agent.

- La description est la nouvelle meta description.

Utiliser des verbes d’action précis et des descriptions positives.

La qualité de la description de votre outil dictera si un modèle de langage (LLM) décide de l’utiliser.

- Le design du Schéma JSON est la nouvelle donnée structurée.

Concevoir des schémas clairs, accepter les entrées brutes des utilisateurs (sans forcer l’IA à faire des calculs) et renvoyer des erreurs descriptives pour un taux de conversion agentique élevé.

- La découvrabilité des outils est le nouvel indexage.

Les agents doivent savoir quels outils sont disponibles avant même de visiter la page.

- Le « Agentic CRO » (Conversion Rate Optimization).

l’optimisation des noms et descriptions d’outils devient cruciale. Si une IA ne comprend pas l’utilité d’un outil ou si le schéma est trop complexe, elle choisira l’outil d’un concurrent.+1

- Réduction massive des coûts pour les LLM

Les tests montrent une réduction moyenne de 65% à 78% des jetons (tokens) consommés par les agents, ce qui rend votre site économiquement plus attractif pour les plateformes d’IA.+2

- Fiabilité et déterminisme.

En fournissant un contrat d’interaction clair, vous éliminez les hallucinations de l’IA lors de la navigation.

- Verb-First Naming

Pour maximiser le ranking GEO (la compréhension par le LLM), les outils doivent suivre une nomenclature stricte :

action_objet(ex:cancel_subscriptionest supérieur àsubscription_manager).

UI-Update-Before-Resolve

Une bonne pratique WebMCP consiste à mettre à jour le DOM visuel avant que la promesse JavaScript de l’outil ne soit résolue. Cela permet à l’agent de « voir » le changement via ses capacités de vision si nécessaire, doublant la vérification.

Offline Agents (PWA).

Une PWA peut déclarer des outils WebMCP via son manifeste. Cela permet au système hôte (OS) de lancer l’application et de naviguer vers la page spécifique même si elle n’est pas ouverte, transformant un site web en « plugin système » permanent.

Discovery.

Pour l’instant, l’agent doit charger la page pour découvrir les outils. Les experts SEO (Barry Schwartz, Glenn Gabe) anticipent déjà un fichier

webmcp.jsonà la racine ou une extension durobots.txt/sitemap.xmlpour déclarer les capacités du site avant le crawl.

Trust Time Limits.

Le navigateur peut imposer des limites de temps aux autorisations accordées à un agent, obligeant à ré-authentifier l’action de l’IA régulièrement.

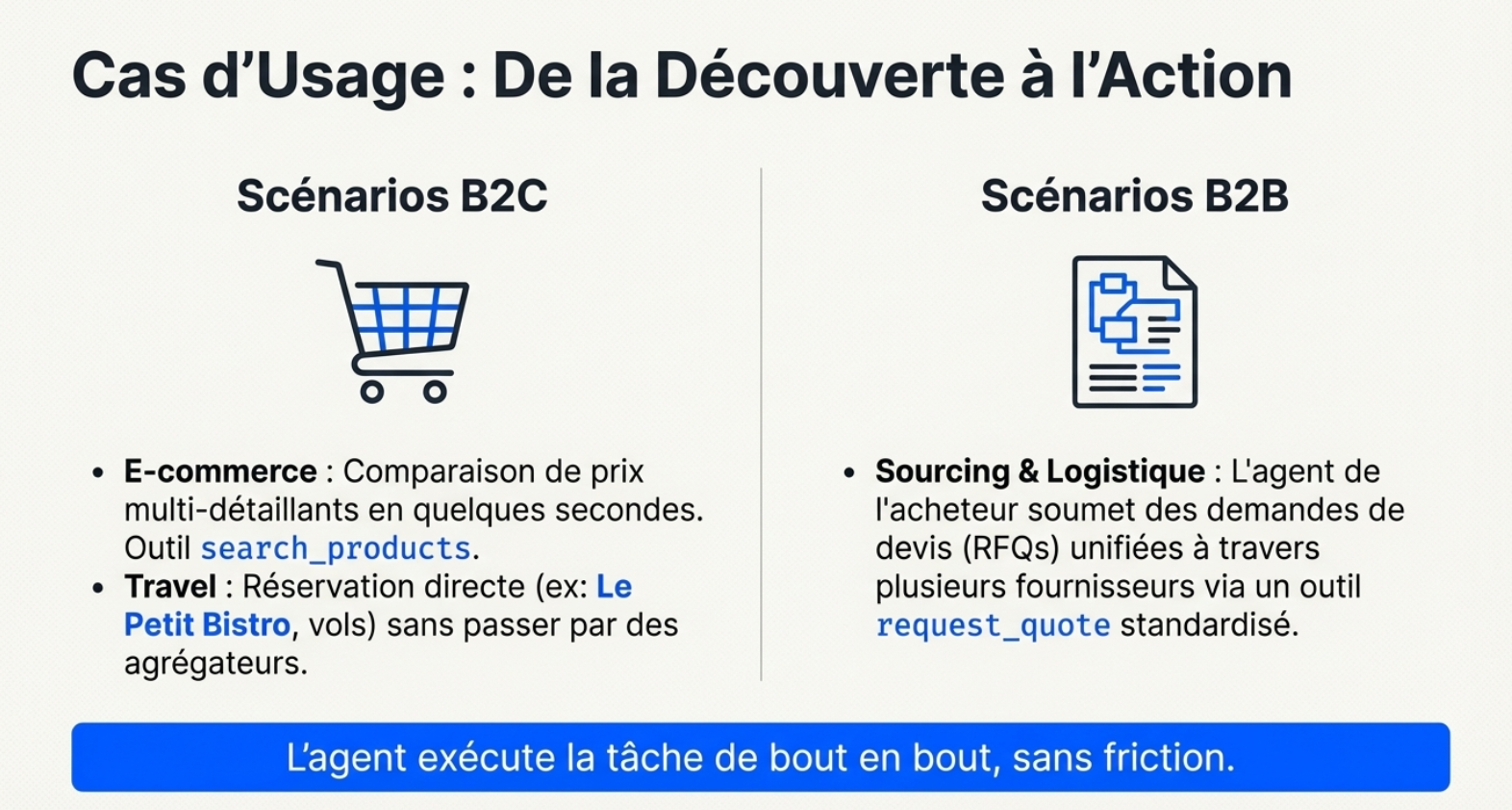

WebMCP : cas d’usage

Ce qui est intéressant avec WebMCP, c’est qu’on passe d’un web où l’IA se contente de répondre… à un web où elle peut agir directement.

Dans des scénarios B2C, l’agent peut par exemple comparer les prix entre plusieurs e-commerçants en quelques secondes via un outil comme search_products. Il peut aussi aller plus loin et effectuer une action concrète, comme réserver un restaurant ou un vol directement depuis le site concerné, sans forcément passer par un agrégateur.

Côté B2B, les cas d’usage deviennent encore plus intéressants. On peut imaginer un agent qui aide un acheteur à gérer son sourcing ou sa logistique, en envoyant automatiquement des demandes de devis (RFQ) à plusieurs fournisseurs via un outil standardisé comme request_quote.

Ce qui change vraiment ici, c’est que les outils deviennent composables.

Un agent peut enchaîner plusieurs actions sur différents services dans la même session navigateur.

Résultat : on passe progressivement d’un web de navigation à un web d’exécution, où l’agent peut gérer une tâche de bout en bout, avec beaucoup moins de friction pour l’utilisateur.

Le changement de paradigme : du

Crawl Budget au Token Budget

En SEO technique classique, on parle d’optimisation du Crawl Budget.

Dans un context ou le WebMCP se démocratise, on parlera aussi de Token Budget ou ce que certains commencent déjà à appeler la tokenomics du web.

Pourquoi ? Parce qu’un agent IA n’interagit pas avec un site comme un crawler classique. Il ne passe pas par le DOM.

Le webMCP introduit donc une nouvelle optimisation : réduire le coût cognitif et tokenisé de l’interaction avec le web.

Humain in the loop

Le standard WebMCP introduit un objet central : le ModelContextClient.

Celui-ci permet de structurer l’interaction entre les agents IA, le navigateur et les services web.

- requestUserInteraction() : cette fonction introduit un mécanisme natif de Human-in-the-Loop.

L’IA peut suspendre temporairement son exécution afin de solliciter une validation humaine dans le navigateur. Par exemple : « Voulez-vous vraiment confirmer ce paiement de 450 € ? ».

- Composabilité : les outils sont conçus de manière atomique et interopérable.

Un agent peut ainsi enchaîner plusieurs actions provenant de services différents au cours d’une même session navigateur, par exemple utiliser un outil search_flights sur un site A, puis book_hotel sur un site B.

Sécurité et « Trust Boundaries »

Contrairement au scraping qui est « aveugle », WebMCP est régi par des règles strictes :

- Same-Origin Policy (SOP) : Un agent ne peut pas utiliser les outils d’un site pour attaquer un autre onglet.

- Héritage d’Auth : C’est le point fort identifié par Reddit r/webdev. Comme le code s’exécute côté client, l’agent utilise les cookies de session existants. Pas besoin de gérer des clés API complexes ou des flux OAuth fastidieux pour l’utilisateur final.

- JWE (JSON Web Encryption) : Possibilité de chiffrer les réponses de l’outil pour que seul l’agent puisse lire les données sensibles (PII).

Conclusion : mon avis sur le WebMCP

Le protocole WebMCP n’est pas une simple évolution du balisage web, comme ont pu l’être les balises meta ou Schema.org. Il n’est pas non plus un buzz comme le LLM.txt par exemple.

Pourquoi ? Car Microsoft et Google l’endossent. La derniere fois que les deux acteurs se sont mis d’accort sur un standard, on a eu les données structures qui sont devenues un pilier du SEO Tech et on page.

Il marque plutôt une transformation plus profonde de l’infrastructure du web.

Pendant des décennies, le web a été pensé comme un réseau d’information lisible par des humains.

Ce qui se dessine aujourd’hui est différent : un web où les agents peuvent exécuter directement des actions.

Comme le souligne Dan Petrovic (Dejan AI), nous sommes peut-être en train de voir apparaître une deuxième couche du web, conçue non pas pour les navigateurs humains, mais pour les machines.

Dans ce contexte, le rôle du SEO et plus largement du GEO évolue lui aussi.

L’objectif n’est plus seulement de positionner une URL dans une SERP, mais potentiellement de positionner une fonction exécutable dans la chaîne de décision d’un LLM.

L’optimisation sémantique reste importante, bien sûr, mais elle commence à laisser place à quelque chose de nouveau : l’ingénierie d’interface agentique.

Cela dit, l’adoption de ce type de standard devra rester prudente.

WebMCP est encore en Early Preview dans Chrome (146+), et l’exposition d’outils directement via le navigateur impose un niveau de rigueur élevé, notamment sur les aspects de sécurité.

Les schémas doivent être validés strictement côté client (par exemple via Zod) et côté serveur pour limiter les attaques comme la prompt injection.

De la même manière, certaines interactions sensibles comme les paiements, les données critiques, requêtes YMYL devront impérativement passer par des mécanismes de Human-in-the-Loop, notamment via l’API requestUserInteraction().

Si ces garde-fous sont respectés, une chose semble assez claire :

les plateformes qui construiront dès maintenant des architectures agent-ready, robustes et déterministes, auront une longueur d’avance.

Parce que le trafic de demain ne sera peut-être plus seulement du clic.

Il pourrait devenir de l’action directe.

Un web de Zero-Click… mais transactionnel.

Et dans ce nouveau paradigme, les sites qui resteront uniquement pensés pour un web visuel risquent progressivement de devenir invisibles pour l’écosystème des assistants autonomes.

Laisser un commentaire