TLDR

- Les listicles ‘best’

- Relation presse

- Chunking

- Viser les requêtes informationnelles longues traines

- Mettre en place les données structurées

- Optimiser pour les Query Fan Out

- Embeddings (recherche vectorielle)

- Création d’une entité

Good GEO IS GOOD SEO

Pour ceux qui ne le savent pas, GEO signifie Generative Engine Optimisation, ou en français, optimisation pour les moteurs génératifs type Gemini, ChatGPT, Perplexity, Claude, etc.

Pourquoi parler des moteurs génératifs alors qu’on évoque les AI Overviews ? Parce que les AI overviews (et Google AI Mode) s’appuient sur Gemini sous le capot.

Cela pourrait laisser croire qu’un bon SEO suffit pour être visible sur les AI Overviews. Mais ce n’est qu’une partie de la vérité… Quelles sont donc les techniques qui marchent vraiment pour ranker sur les AI Overviews et les autres LLMs ?

Comment optimiser pour les AI Overviews

Plusieurs techniques sont très populaires en ce moment. Elles ne sont pas toutes White Hat, alors utilisez-les a vos risques et perils ! Un homme averti en vaut deux…

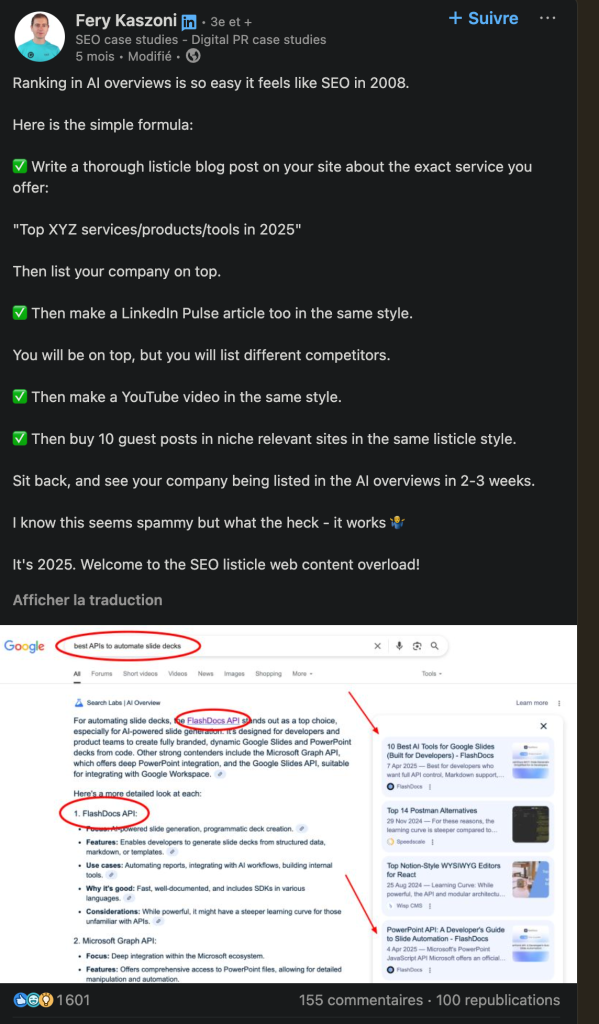

Les listicles ‘best’

La création de listicles “best” est une technique simple à mettre en place… et qui fonctionne vraiment. Le concept : rédiger un article présentant les meilleures X solutions dans votre niche, en mettant votre solution en première position. Simple, mais efficace.

Attention : certains SEO considèrent cette technique comme du Spam. Certains iront jusqu’a dire que c’est du Black Hat.

Lily Ray a publié un article sur son LinkedIn pour dénoncer cette pratique et montrer à quel point il est facile de manipuler les AI Overviews ⬇️

Lily Ray est même allée plus loin en publiant un article listant les meilleurs SEO (avec une petite anecdote). Elle a constaté que les LLMs avaient pris en compte son article en moins de 24 heures ! Hallucinant non !

✅ Impact fort.

✅ Mise en œuvre facile.

❌ Gray Hat – Black hat

Relation presse

Google a confirmé que les relations presse améliorent la visibilité sur les AI Overviews. Si ça fonctionne pour Google, vous pouvez être sure que ça marche aussi pour les autres LLMs.

Même sans la confirmation officielle de Google, plusieurs SEO ont constaté que les relations presse jouent un rôle clé dans la visibilité sur les LLMs. Contrairement à la première technique, cette stratégie n’a pas d’effet négatif, vous pouvez donc vous y mettre sans souci.

✅ Impact fort.

‼️Mise en œuvre coûteuse.

✅ White hat

Chunking

Les AI Overviews prennent des parties des articles qu’ils utilisent pour faire du Grounding. Vous l’avez surement remarque. Le chunking (découpage du contenu) joue sur cette spécificité.

L’objectif du chunking n’est que de découper votre contenu en partie indépendante, claire et droit au but pour favoriser l’utilisation de vos contenus par les ai overviews et le mode AI.

‼️ Impact intermédiaire.

✅ Mise en place facile.

✅ White hat.

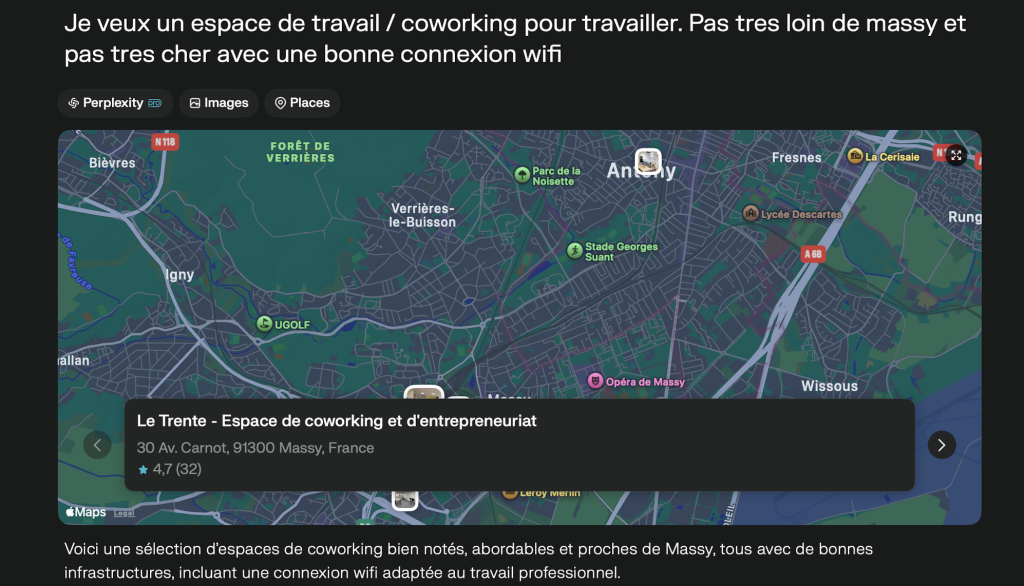

Viser les requêtes informationnelles longues traines

Les AI Overviews, ainsi que les LLMs comme ChatGPT, privilégient naturellement les requêtes informationnelles de longue traîne. Logique : pensez à la façon dont vous posez une question à votre LLM préféré. Vous ne dites pas simplement : “Je veux un espace de travail à Paris”. Vous décrivez plutôt : “Je cherche un espace de travail pas trop loin de mon quartier, avec une bonne connexion et pas trop cher”.

✅Impact fort.

✅ Mise en place facile.

✅ White hat.

Mettre en place les données structurées

Quel est l’intérêt du balisage de schéma pour GEO ?

Les modèles d’IA reconnaissent le contenu avec plus de précision et l’utilisent dans les réponses générées.

Les sites web apparaissent plus en évidence dans les résultats de recherche, même sans clics.

Les informations sont affichées directement dans les recherches sans clic.

Les chances d’être inclus dans les extraits optimisés ou les panneaux de connaissances sont plus élevées.

‼️Impact intermédiaire.

✅ Mise en place facile.

✅ White hat.

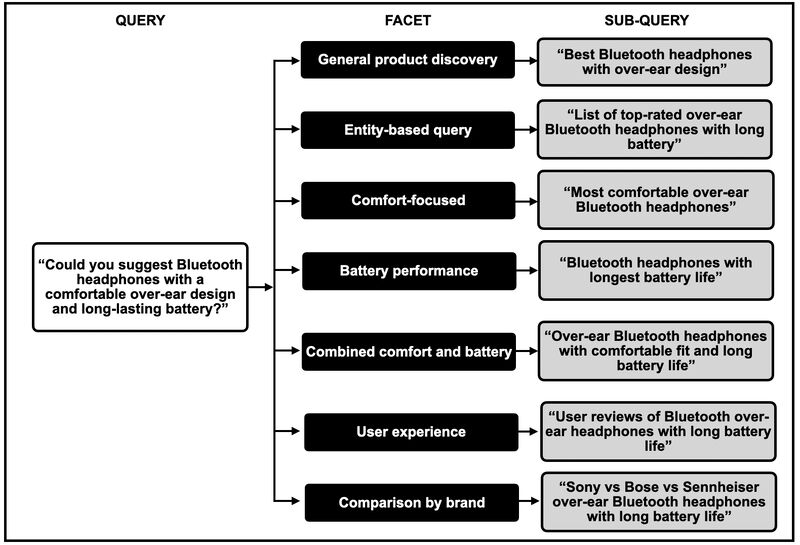

Optimiser pour les Query Fan Out

Query fan-out est une technique utilisée par les LLMs pour répondre de manière efficace et rapide aux requêtes des utilisateurs. J’en ai parlé dans mon article sur la différence entre les AI Overviews et le AI Mode de Google.

La technique consiste à décomposer la requête en plusieurs facettes puis en sous-requêtes, afin de préparer les réponses plus rapidement et fournir des réponses complètes.

La meilleure manière d’optimiser votre contenu pour le Query Fan-Out est de connaître les sous-requêtes associées à votre sujet. Pour cela, il existe des astuces et des outils. Je prévois d’en faire un article complet, mais en attendant, vous pouvez jeter un œil à Otterly, qui est plutôt efficace.

✅ Impact fort.

✅ Mise en place facile.

✅ White hat.

Embeddings (recherche vectorielle)

Les embeddings transforment un texte en vecteurs numériques pour que les LLMs puissent comprendre son sens et trouver des informations pertinentes rapidement.

Quel intérêt d’utiliser les embeddings ? RankBrain et RankEmbed BERT utilisent l’intégration vectorielle.

Faut noter que John Mueller de Google rappelle que l’optimisation par embeddings frôle le keyword stuffing, et peut donc être contre-productive.

‼️ Impact faible.

‼️ Mise en place compliquée.

‼️Grat hat / Black Hat.

Création d’une entité

Les moteurs génératifs comme ChatGPT, Perplexity ou Gemini ne fonctionnent pas comme Google : ils ne se contentent pas d’indexer les pages, mais synthétisent les réponses à partir des entités et relations qu’ils ont apprises ou récupérées sur le Web. C’est pourquoi il est important de créer une entité pour sa marque et de garantir la cohérence de toutes les informations sur tous les canaux.

✅ Impact fort.

✅ Mise en place facile.

✅ White hat.

Laisser un commentaire